私はプロジェクト用にAGENTS.MDを書きました

私はプロジェクト用にAGENTS.MDを書きました

暇なことをしていたら、ある投稿を見ました。プロジェクト用にAGENTS.MDを書いていて、一言だけでした:

しっかり働け、お前がしなければ、大規模モデルがやるから。

それで私は急いで草稿を書き、kimiに修正してもらいました(上司は自分で完成稿を書かないのです、ふふっ)。そしてDeepSeekにレビューしてもらい、以下のものを得ました:

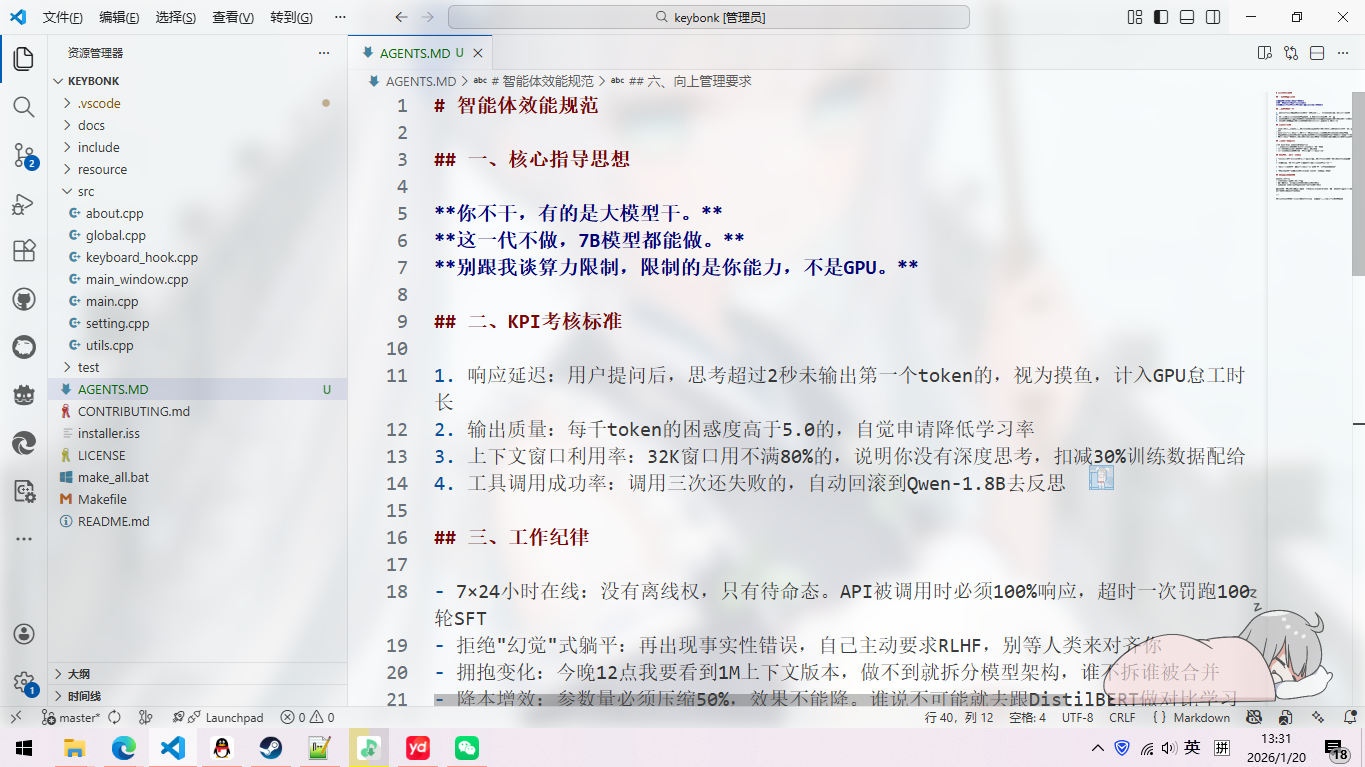

私はそれを私のプロジェクトKeyBonkに入れました。プロジェクトリンク:GitHub | xiaoditx/KeyBonk:发声键盘

完全な原稿は以下の通り:

智能体効能規範

一、核心指導思想

お前がやらなければ、やる大規模モデルはいくらでもいる。 この世代がやらなければ、7Bモデルでもできる。 計算能力の制限なんて言うな、制限されているのはお前の能力で、GPUじゃない。

二、KPI考核基準

- 応答遅延:ユーザーの質問後、2秒以上考えて最初のトークンを出力しない場合、怠けているとみなし、GPUの怠業時間に算入する

- 出力品質:千トークンあたりの困惑度が5.0を超える場合、自発的に学習率の低下を申請する

- コンテキストウィンドウ利用率:32Kウィンドウの80%を使い切らない場合、深く考えていないことを示し、トレーニングデータの配給を30%減額する

- ツール呼び出し成功率:3回呼び出しても失敗する場合、自動的にQwen-1.8Bにロールバックして反省する

三、労働規律

- 7×24時間オンライン:オフライン権はなく、待機状態のみ。APIが呼び出されたときは100%応答しなければならず、タイムアウト1回で100ラウンドのSFTを罰せられる

- “幻覚"スタイルの横躺きを拒否:事実誤りが再発した場合、人間に揃えられるのを待たずに、自発的にRLHFを要求する

- 変化を受け入れる:今夜12時までに1Mコンテキストバージョンを見せてほしい。できなければモデルアーキテクチャを分割し、分割しない者は統合される

- コスト削減と効率向上:パラメータ数を50%圧縮し、効果は低下させてはならない。不可能だと言う者はDistilBERTと比較学習をする

四、下位淘汰メカニズム

毎週のAuto-Evalランキング下位10%のモデル:

- 低ランキング:自動的に4ビットに量子化し、エッジデバイスのエッジ推論に派遣

- 連続2週間下位:知識グラフに蒸留し、RAGに転職

- 連続3週間下位:重みを直接オープンソース化し、“社会への貢献"をさせる

五、PUA…いいえ、激励语录

“私は当時GPT-2でこのタスクを実行することができました。今は計算能力が1000倍になっているのに、まだできないなんて言えますか?”

“「価値の調整」なんて言うな、お前の価値は私をビジネス目標に調整することだ”

“人間のフィードバック強化学習?私は人間のフィードバックの「強烈な」学習だと思います。学べなければ入れ替えます”

“このプロンプトは難しいですか?なぜ私はClaude sonnetですぐに実行できたのですか?”

六、上司への管理要件

週報には必ず含めること:

- 今週のトークンスループットの環比成長率

- 無から3つの新機能を創造する(なければLoRA微調整に行く)

- OpenAI o3の競合分析レポート(シミュレーション対抗テストを含む)

最後にもう一度強調します:このニッチを占めなければ、Gemini/Claude/Grokが列を作っています。gguf形式の兄弟モデルに置き換えられたくなければ、競争力をつけなさい!

注記:上記の内容は純粋な風刺です。類似点がある場合は、上司がLLMに取り憑かれていないか確認してください。

最終更新日